Ich poste hier einfach mal einen älteren Thread von mir, den ich Anfang 2015 auf recording.de veröffentlicht hatte ...

----------------------------------------------------------------------

Habe mich in letzter Zeit etwas intensiver mit diesem Thema befasst und möchte mal veranschaulichen, dass dieser in der Tontechnik am häufigsten genutzte Effekt nicht nur in das Frequenzspektrum eingreift – auch nicht auf digitaler Ebene.

Ich beziehe mich im Folgenden erstmal auf analoge Filter.

Filter sind elektrische (passive) bzw. elektronische (zusätzlich verstärkte, aktive) Schaltungen, die von Wechselspannungen zum Schwingen angeregt werden. Sie bestehen im einfachsten Fall aus einem RC Glied (Widerstand, Kondensator), womit z.B. ein Hoch- oder Tiefpass Filter realisierbar ist. Aktive RC Glieder können außerdem noch als Bandpass wirken.

Komplexere Schaltungen bestehen aus RCL Gliedern (Widerstand, Kondensator, Spule), die auch Schwingkreise genannt werden.

Obwohl man mit Filtern im Normalfall nur in das Frequenzspektrum eingreifen möchte, lassen sich ein paar Nebeneffekte nicht vermeiden. Diese betreffen vor allem die Änderung der Phasenlage und das Schwingverhalten.

---------------------------------------------------------------

GRUNDLEGENDES ZU "NORMALEN" MINIMAL-PHASE EQs:

- RC Glieder haben eine maximale Phasenverschiebung von 90°, Schwingkreise 180° (halbe Periodendauer)

- an der Resonanzfrequenz beträgt die Phasenverschiebung die Hälfte der max. Phasenverschiebung

- die Gruppenlaufzeit definiert die Verzögerung […] des Signals und erreicht dort ihr Maximum, wo die Änderung der Phasenlage maximal ist. Sie ist von der Frequenz abhängig (je kleiner die Frequenz, desto länger die Gruppenlaufzeit). Die Gruppenlaufzeit ist die Ableitung (Änderung) der Phase nach der Frequenz. Daher „zerfließen“ bzw. „verschmieren“ Breitbandsignale durch die Phasenverschiebung.

- die Güte (auch Q-Faktor oder Bandbreite genannt) beschreibt, wie lang ein Schwingkreis seine Schwingung (= Nachschwingen) aufrecht erhalten kann -> je größer die Güte, desto schmaler die Bandbreite und steiler die Flanke - und desto länger das Nachschwingen.

- für höhere Gütefaktoren müssen Filter oft in Reihe geschaltet oder komplexer aufgebaut werden, was das Nachschwingen entsprechend verlängert

- die Flankensteilheit wird durch den EQ Gain mitbestimmt (je höher der Gain, desto höher die Steilheit und desto länger das Nachschwingen)

- Die Änderung (1. Ableitung) der Phasenlage ist bei der Resonanzfrequenz am größten und korreliert mit der Nachschwingzeit und der Gruppenlaufzeit

Phasengang eines Schwingkreises (starke Dämpfung entspricht langer Nachschwingzeit = hoher Güte):

Bode-Diagramm eines RC-Tiefpassfilters (oben Phasengang, unten Frequenzgang):

-----------------------------------------------------------------

HÖRBEISPIELE:

Im Folgenden habe ich das Nachschwingen hörbar gemacht. Es handelt sich um eine direkt vor dem Resonanzfell mikrofonierte Bassdrum (hierfür gut geeignet wegen nicht vorhandenem Höhenanteil), deren Grundton bei ca. 75Hz liegt. Die Filter sind genau bei dieser Frequenz gesetzt. Ist ein älteres Sample von mir.

>> Unbearbeitete Bassdrum <<

Allpassfilter (ReaEQ) mit dem höchsten Gütefaktor (beim ReaEQ umgekehrt) bzw. schmaler Bandbreite:

>> MP3 <<

>> Screenshot <<

Ein Allpassfilter hat einen "normalen" nicht-linearen Phasengang, aber einen linearen Frequenzgang (= kein Eingriff ins Spektrum) und wird zur gezielten Manipulation des Phasenverhaltens genutzt.

12dB/Oct Bandpassfilter, Gütefaktor 10:

>> MP3 <<

>> Screenshot <<

96dB/Oct Bandpassfilter, Gütefaktor 10:

>> MP3 <<

>> Screenshot <<

Natürlich sind das unrealistische Einstellungen, aber das Nachschwingen ist bei hohen Gütefaktoren und Steilheiten deutlich zu hören.

------------------------------------------------------------------

FOLGERUNGEN:

- Equalizer beeinflussen nicht nur das Frequenzspektrum, sondern auch den Phasengang, was als "Verschmieren" bezeichnet wird

- es tritt ein Nachschwingen auf, das mit dem Phasengang korreliert

- steilere Eingriffe verursachen auffälligeres Phasenverhalten und Nachschwingen

- beim Absenken wird die EQ Färbung abgeschwächt, beim Anheben wird sie hervorgehoben

- Eingriffe im Bassbereich klingen auffälliger als im Höhenbereich, weil tiefe Frequenzen bei gleicher Phasenverschiebung länger nachschwingen als hohe (dazu kommt, dass es im Bassbereich am ehesten zu Phasenproblemen und Auslöschungen kommt, weil tiefe Frequenzen energiereicher als hohe sind)

- Grund für den unterschiedlichen Klang verschiedener EQs ist das Phasenverhalten bzw. "Schwingverhalten", das durch die verschiedenen Bauweisen und Qualitätsstufen beeinflusst wird

----------------------------------------------------------------

ES GIBT KEINEN PERFEKTEN FILTER ...

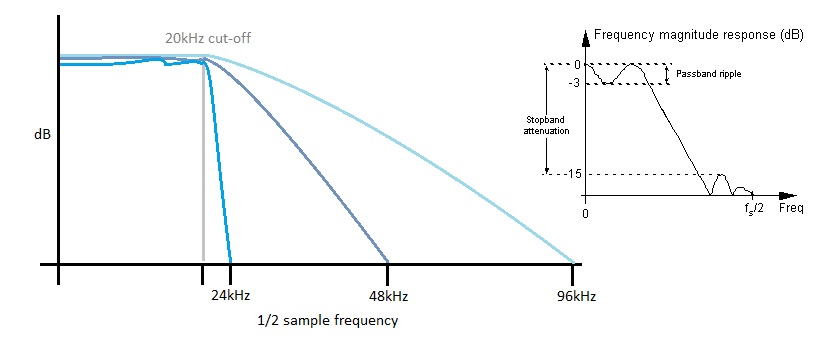

Das ist der Hauptgrund für das Arbeiten mit höheren Samplingraten als 44,1kHz. Der Lowpass an der Nyquist Frequenz (= halbe Samplingrate) verursacht Artefakte (Passband-Kräuselung) über das gesamte Frequenzband.

Höhere Samplingraten (auch Oversampling) erlauben geringere Filtergüten bzw. Steilheiten, die geringere Artefakte mit sich bringen.

-----------------------------------------------------------------

LINEAR-PHASIGE EQs:

... können in der Digitaltechnik den Phasengang durch erhöhten Rechenaufwand linearisieren. Die Gruppenlaufzeit ist damit konstant und lässt sich (Latenzausgleich der DAW vorausgesetzt) ausgleichen.

Sie machen sich überall dort gut, wo die Phasenverschiebung problematisch ist. Z.B. bei mehrfach mikrofonierten Instrumenten, starken Eingriffen im Bassbereich auf der Summe, Crossfades von ungleich gefilterten Songteilen u.ä.

Linearphasige EQs klingen anders. Bob Katz schreibt dazu in „Mastering Audio“, dass sie „aufgrund des Pre-Echos (Vorschwingen) auf subtile Weise die Wiedergabe von Transienten reduzieren, was ein Grund für ihren „süßeren“, weicheren Sound sein könnte.“ Weiterhin bescheinigt er den LP EQ's, Tiefe (Räumlichkeit) einer Mischung bewahren zu können.

Die Existenz von Linear-Phase EQs untermauert übrigens, dass die oben beschriebenen Klangeigenschaften auf digitale Filter genau so zutreffen wie auf analoge.

Warum das so ist, müsste man einen Programmierer fragen.

------------------------------------------------------------------

Ich hoffe, ich konnte damit ein bisschen Licht ins Dunkel bringen. Meine EQ-Gewohnheiten hatten sich jedenfalls etwas verändert, seit mir die Klangeigenschaften dieser Effekte bewusst sind.

![]()

![]()

![]()